flink项目总结

2023-03-27 15:16:20 1 举报

AI智能生成

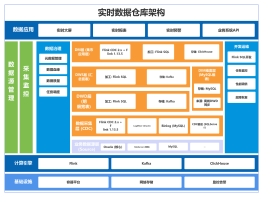

对于直播平台的实时分析 需求分析,技术点等

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页