2026最新Transformer、混合专家模型、多模态、GAN、GCN、Diffusion

2026-03-11 18:08:02 10 举报

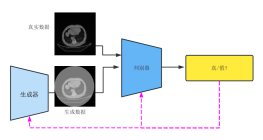

在前沿AI技术的不断演进中,各种创新模型正不断涌现,以支持多样化的需求与挑战。Transformer模型以其自注意力机制在自然语言处理(NLP)中一骑绝尘,极大地推进了机器翻译、文本生成等领域的智能化程度。混合专家模型则结合了多种专家系统与深度学习的精髓,优化决策流程,助力提升性能。多模态学习同时处理文本、图像、音频等多种数据模式,赋予机器理解世界多维度的能力。生成对抗网络(GAN)在无监督学习中开创了生成逼真图像与数据的新篇章。图卷积网络(GCN)则专门针对图结构数据,应用在社交网络分析、生物信息学等复杂结构的场景中。扩散模型(Diffusion)为生成模型领域带来了新思路,通过模拟数据生成过程的逆过程,它成功地生成了高质量、高分辨率的图像与声音。未来,这些核心模型将继续扩展人工智能的边界,实现更加智能的多功能应用,为科技的发展增添无限可能。

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页