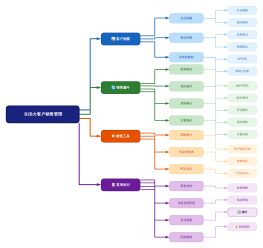

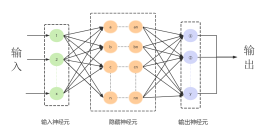

深度神经网络Transformer模型结构图

2026-03-02 17:44:46 0 举报

详细绘制Transformer的Encoder和Decoder模块内部结构,包含Multi-Head Attention、Add & Norm、Feed Forward等组件。使用清晰的连接线展示数据流向,右侧添加文字注释解释各模块功能。适合教学或技术文档使用。