Kafka面试通关秘籍

2021-02-22 14:28:25 241 举报

AI智能生成

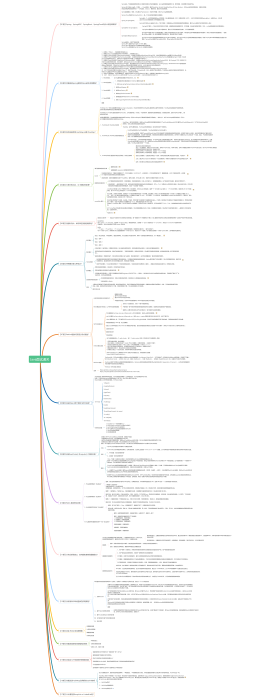

Kafka面试通关秘籍

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页