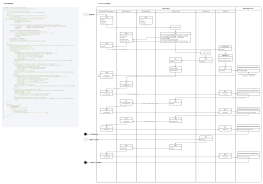

服务端启动

创建ServerSocketChannel

new NioServerSocketChannel()<br>

newSocket(PROVIDER) -> ServerSocketChannel

this.readInterestOp = SelectionKey.OP_ACCEPT 保存关心的事件为Accept

初始化ServerSocketChannel

添加之后的结构

注册selector

AbstractChannel.this.eventLoop = eventLoop;<br>将分配到的EventLoop保存至chanel内部<br>

将Netty-Channel内部的jdk-Channel注册至该EventLoop绑定的selector上,此时并不关心事件<br>selectionKey = javaChannel().register(eventLoop().selector, 0, this);<br>

获取注册后的selectionKey作为Netty-Channel的成员变量<br>

服务端口绑定

jdk-Channel绑定端口<br>javaChannel().bind(localAddress, config.getBacklog());<br>

绑定完毕,触发channelActive事件<br>HeadContext ctx.fireChannelActive();<br>

触发完毕,调用HeadContext.readIfIsAutoRead();<br>

传播至HeadContext.read()<br>-> unsafe.beginRead();<br>-> doBeginRead() 修改SelectionKey感兴趣的事件为创建时保存的兴趣事件

创建时保存感兴趣事件,创建jdk-Channel并创建id, unsafe, pipeline

服务端初始化主要用于在pipeline添加ServerBootstrapAcceptor处理器<br>用于将监听到的客户端Channel注册至客户端Group中

注册主要目的用于将<br>register() -> Netty-Channel注册至EventLoop (表现行为为保存EventLoop引用)<br>register0() -> jdk-Channel注册至selector上 (通过jdk的方式注册)<br>

全部由HeadContext节点处理

NioEventLoop<br>

创建

executor = new ThreadPerTaskExecutor(newDefaultThreadFactory())

factory -> new FastThreadLocalThread(threadGroup, r, name)

execute -> threadFactory.newThread(command).start()<br>

this.executor = ObjectUtil.checkNotNull(executor, "executor");

taskQueue = newTaskQueue(this.maxPendingTasks);

selector = openSelector();

chooser = chooserFactory.newChooser(children);

EventExecutorChooser.next()轮询选择EventLoop

启动

SingleThreadEventExecutor.execute(task)<br>

this.thread为null -> 非nio线程 -> doStartThread()

executor.execute()创建FastThreadLocalThread<br>

thread = Thread.currentThread();<br>保存由executor分配的线程(FastThreadLocalThread)

SingleThreadEventExecutor.this.run(),在该线程中正式启动EventLoop

addTask(task) -> taskQueue.offer(task) 添加此任务由eventloop执行

执行逻辑

检测IO事件和任务队列

获取最新要执行的定时任务的deadline作为这次select的deadline<br>

hasTasks()为穿插任务,当出现穿插任务时,跳出这次select<br>

selector.select(timeoutMillis) 进行阻塞式select<br>

当检测到未实际阻塞并且超过selectCnt阈值512

触发空轮训bug -> rebuildSelector();

newSelector = openSelector();

Register all channels to the new Selector.

处理IO事件

在默认优化的前提下,<br>SelectorImpl的selectedKeys和publicSelectedKeys已被反射替换为new SelectedSelectionKeySet(),<br>该实现通过数组的方式优化了HashSet<br>

processSelectedKeysOptimized(selectedKeys.flip())

processSelectedKey(SelectionKey k, AbstractNioChannel ch)

任务执行<br>

循环获取scheduledTask.deadlineNanos() <= nanoTime的定时任务<br>即将需要执行的定时任务合并至taskQueue

在deadline(ioRatio默认1:1)之内时循环执行taskQueue中的task<br>

2 * cpu<br>AbstractBootstrap.doBind0() -> channel.eventLoop().execute -> channel.bind<br>当execute调用时,当分配到的EventLoop尚未启动时触发线程的启动执行<br>在绑定结束后,会触发pipeline的channelActive事件<br>

实际阻塞的select操作未发生阻塞并超过阈值则重新构建selector

当外部线程调用eventLoop或channel方法时<br>将外部线程执行的任务封装成task丢至EventLoop顺序执行<br>

新连接接入

新连接检测<br>

processSelectedKey(SelectionKey k, AbstractNioChannel ch)

NioServerSocketChannel.doReadMessages()<br>调用accept方法获取jdk SocketChannel<br>

buf.add(new NioSocketChannel(this, ch)) 包装成netty channel

pipeline.fireChannelRead(readBuf.get(i))<br>allocHandle用来控制accept速率<br>

NioSocketChannel的创建<br>

this.readInterestOp = SelectionKey.OP_READ 保存关心的事件为read

ch.configureBlocking(false);

javaSocket.setTcpNoDelay(true);

Netty中Channel的分类

Channel 层级关系

ChannelConfig 层级关系

新连接分配NioEventLoop并注册Selector<br>

服务端channel初始化时触发Acceptor的添加<br>ServerBootstrap.init(Channel channel) -> pipeline.addLast(new ServerBootstrapAcceptor())<br>

检测到新连接时触发NioMessageUnsafe.read() -> pipeline.fireChannelRead(readBuf.get(i));

触发ServerBootstrapAcceptor.channelRead(ChannelHandlerContext ctx, Object msg)

Acceptor的channelRead逻辑

child.pipeline().addLast(childHandler);

对新连接设置options和attrs

childGroup.register(channel)<br>新连接注册至workerGroup

next().register(channel)<br>通过chooser选择一个NioEventLoop进行注册<br>

AbstractUnsafe.register(EventLoop eventLoop, final ChannelPromise promise)<br>doRegister() -> selectionKey = javaChannel().register(eventLoop().selector, 0, this) <br>此时注册至selector但并不关心事件<br>

总结:在boss中的NioEventLoop检测到新连接,注册至worker中的NioEventLoop

NioSocketChannel读事件注册<br>

入口:pipeline.fireChannelActive();

HeadContext.channelActive(ChannelHandlerContext ctx)

HeadContext.readIfIsAutoRead()

HeadContext.unsafe.beginRead();

AbstractNioChannel.doBeginRead()<br>selectionKey.interestOps(this.readInterestOp)<br>传播结束回到头结点,此时实际设置感兴趣的事件<br>

select检测到新连接

processSelectedKey 处理jdk-客户端channel<br>此时创建Netty-channel保存感兴趣的事件

触发服务端读事件至ServerBootstrapAcceptor.channelRead<br>调用childGroup.register(child),通过choose分配EventLoop<br>Netty-Channel保存分配的EventLoop并将Channel保存的jdk-Channel注册至selector

注册完毕触发ChannelActive事件<br>由HeadContext触发beginRead,此时将开始监听实际感兴趣的事件<br>

eventloop -> processSelectedKeys();

NioMessageUnsafe.read() <br>-> doReadMessages(readBuf)<br>-> javaChannel().accept()<br>-> new NioSocketChannel(this, ch)<br>-> pipeline.fireChannelRead(readBuf.get(i));<br>-> ServerBootstrapAcceptor.channelRead()<br>-> childGroup.register(channel)<br>-> next().register(channel)

注册的两个部分

register() 保存选择出来的eventLoop

register0() jdk-channel实际注册,未监听任何事件

beginRead() 监听感兴趣的事件

ChannelPipeline<br>

pipeline初始化<br>

new AbstractChannel(Channel parent)<br>-> pipeline = newChannelPipeline()<br>-> new DefaultChannelPipeline(Channel channel)

this.channel = ObjectUtil.checkNotNull(channel, "channel");<br>tail = new TailContext(this);<br> head = new HeadContext(this);<br>head.next = tail;<br> tail.prev = head;<br>

pipeline默认结构

添加ChannelHandler

ChannelPipeline.addLast(ChannelHandler... handlers)<br>

判断是否重复添加<br>checkMultiplicity(handler);<br>

创建节点<br>newCtx = newContext(group, filterName(name, handler), handler);<br>

添加至链表<br>addLast0(newCtx);<br>

回调添加完成事件<br>callHandlerAdded0(newCtx);<br>-><br>ctx.handler().handlerAdded(ctx);<br> ctx.setAddComplete();<br>

删除ChannelHandler

问题

根据class类型

根据传播规律添加

ctx当前节点<br>pipeline头尾传播<br>

ByteBuf

ByteBuf结构及重要API

结构

read,write改变指针,set,get不改变指针

mark用于记录当前指针,reset用来修改指针为mark所指的位置

ByteBuf分类

分类-1

分类-2

池化与非池化由子类实现

safe和unsafe自动检测

heap与direct由api提供

ByteBufAllocator内存分配器<br>

UnpooledByteBufAllocator

heap通过创建数组[]分配内存

direct通过调用jdk-nio创建直接内存ByteBuffer

PooledByteBufAllocator

结构

PoolArena<br> - DirectArena<br> - HeapArena<br>Thread通过PoolThreadLocalCache创建的PoolThreadCache与某个Arean绑定<br>PooledByteBufAllocator每次创建时同时创建2种Arean

内存规格

MemoryRegionCache<br>

每个节点为该种规格的RegionCache,通过内部的queue来存储这种规格的内存<br>

PoolThreadCache结构

Thread - PoolThreadCache - Allocator 三者关系

Arenas默认大小为2 * cpu核心数<br>Arena用于开辟一块连续内存

PoolThreadCache - MemoryRegionCache 关系 memCache用于缓存一块连续内存

PoolArena结构

Chunk结构以及Page切分

缓存的分配流程

PooledByteBufAllocator.newDirectBuffer(int, int)<br>-> directArena.allocate<br>-> newByteBuf(maxCapacity); 从Recycler中获取一个纯净对象<br>-> allocate(cache, buf, reqCapacity); 给这个纯净对象分配内存

PoolThreadCache.allocateNormal(PoolArena<?>, PooledByteBuf<?>, int, int)<br>首先在cache上进行内存分配

PoolArena.allocateNormal(PooledByteBuf<T>, int, int)<br>cache无法内存分配时,由arena分配

命中缓存的分配流程

计算缓存节点,tiny通过除以16得出节点下标<br>拿到MemoryRegionCache

MemoryRegionCache.queue.poll(); 弹出一个Entry<br>initBuf(); 将弹出的entry所代表的内存分配给ByteBuf<br>-> buf.init() 完成初始化

entry.recycle(); 将弹出的entry丢回对象池(默认只回收1/8)

未命中缓存的分配流程

page级别内存分配<br>PoolArena.allocateNormal(PooledByteBuf<T>, int, int)<br>

PoolChunkList.allocate(PooledByteBuf<T>, int, int)<br>第一次,此时List内部为空,即还没有chunk

Chunk通过一个平衡二叉树来保存内存分配情况

PoolChunk.allocateRun(int)<br>-> int d = maxOrder - (log2(normCapacity) - pageShifts); 计算需要在第几层分配<br>-> int id = allocateNode(d); id即表示树中的第几个节点,作为handle返回<br>-> updateParentsAlloc(id); 标记父节点内存被使用<br><br>PoolChunk.initBuf(PooledByteBuf<T>, long, int)<br>-> PooledByteBuf.init(PoolChunk<T>, long, int, int, int, PoolThreadCache) <br>分配完毕,保存chunk和handle即可指向一块内存<br>

subpage级别内存分配

ByteBuf的回收

拿到MemoryRegionCache节点,添加至队列

当缓存队列满后加入失败,则标记分配到的连续内存为未使用

通过recycle()回收至Recycler

总结

heap/direct safe/unsafe pooled/unpooled<br>

Allocator持有Arena数组,Arena用于分配内存<br>通过PoolThreadCache将线程与Arena绑定,默认一个Nio线程持管理一个Arena<br>

huge - 直接分配 <br>normal - page <br>small/tiny - subpage<br>

Netty解码

ByteToMessageDecoder<br>

通过cumulation累加字节

decodeRemovalReentryProtection(ctx, in, out);<br>调用子类的docode方法进行解析

未解析数据则跳出循环<br>解析到数据至out时则循环传播解析到的list后clear<br>

FixedLengthFrameDecoder<br>

直到可读字节数达到一帧则读取ByteBuf至out<br>

LineBasedFrameDecoder

以\r\n或\n作为分隔符读取一帧<br>

当发现已经超出所设的最大长度时,则丢弃下一个分隔符前的所有字节

DelimiterBasedFrameDecoder<br>

构建时当发现分割符为LineBase则初始化LineBasedFrameDecoder

逻辑同LineBasedFrameDecoder<br>当有多个分隔符时,每次取最小的帧,即以最近的分隔符为截止点

LengthFieldBasedFrameDecoder

frameLength += lengthAdjustment + lengthFieldEndOffset;<br>当frameLength大于最大帧限制时,直到将该帧字节全部丢弃完毕才会退出丢弃模式,逻辑同其余解码器<br>

总结

通过一定规则累积ByteBuf,当满足一帧时向后传播

如上

Netty编码

writeAndFlush()

通过pipeline调用时从tail节点传播,否则从当前节点传播,见pipeline传播机制

acceptOutboundMessage(msg)<br>I cast = (I) msg;<br>匹配对象<br>

buf = allocateBuffer(ctx, cast, preferDirect);<br>分配内存

encode(ctx, cast, buf);<br>编码实现,由子类实现

ReferenceCountUtil.release(cast);<br>释放对象

ctx.write(buf, promise);<br>传播数据

buf.release();<br>释放内存

HeadContext.write(ctx, msg, promise)<br>-> unsafe.write(msg, promise);

msg = filterOutboundMessage(msg);<br>检测msg类型是否支持,将buf变为directBuf<br>

outboundBuffer.addMessage(msg, size, promise);

添加至buffer

setUnwritable(invokeLater);<br>-> fireChannelWritabilityChanged(invokeLater);<br>当大于64 * 1024时,设置不可写状态<br>

outboundBuffer.addFlush();<br>当总pending字节小于低水位时则设置为可写状态<br>

状态

AbstractNioByteChannel.doWrite(ChannelOutboundBuffer in)

in.current()<br>拿到flushedEntry的msg

ByteBuf buf = (ByteBuf) msg;<br>

in.remove();

当jdk底层无法写入时,之后可能的某个状态

问题

通过编码规则写入ByteBuf,通过ctx或pipeline传递至HeadContext节点

Netty设计模式应用

单例模式

ReadTimeoutException

MqttEncoder<br>

策略模式

DefaultEventExecutorChooserFactory.newChooser(EventExecutor[])

PowerOfTowEventExecutorChooser

GenericEventExecutorChooser

观察者模式

ChannelFuture为被观察者<br>addListener添加监听器即观察者<br>

writeAndFlush()<br>Promise为被观察者<br>Future为观察者<br>

责任链模式

Pipeline

责任处理器接口<br>ChannelHandler<br>

责任链<br>ChannelPipeline<br>

上下文<br>ChannelHandlerContext<br>通过ctx next/prev构成双向链表

责任终止机制<br>netty - fire<br>other - return false