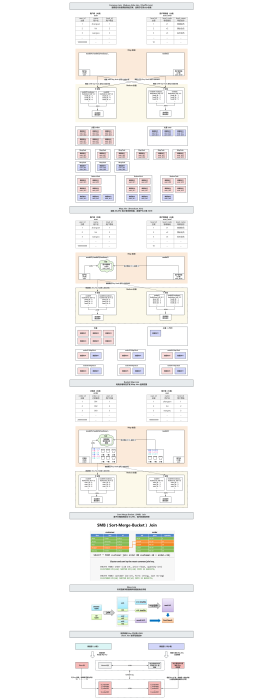

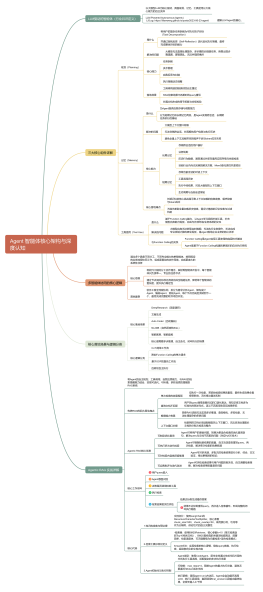

HIve核心组件图与HQL底层实现原理

2021-10-20 15:43:47 1 举报

Hive核心组件以及HQL底层实现原理

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页