算法 - 自然语言 NLP,LLM

2025-08-14 10:57:16 8 举报

AI智能生成

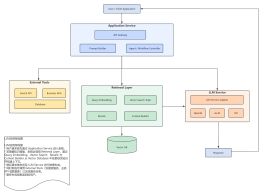

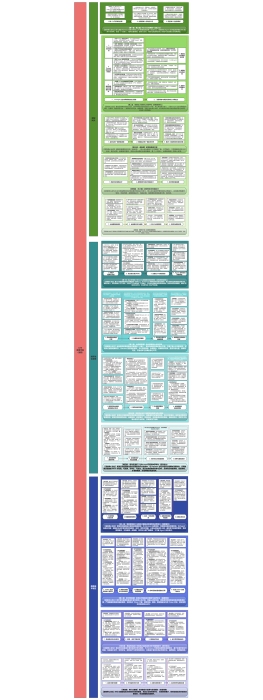

图谱算法主要涵盖:自然语言处理,语言模型,大模型 也聊聊语言发音技巧,词汇规律,工程调优。

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页