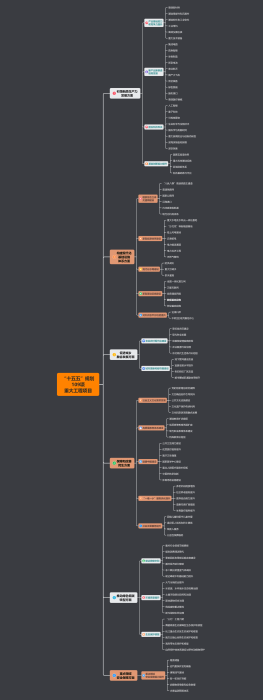

大模型理论基础(打好基础,迭代更新自己的笔记)

2025-06-03 23:43:34 0 举报

AI智能生成

大模型理论基础是一项集成了计算机科学、数学、统计学和语言学等多学科知识的技术成就,它强调了深度学习和大规模数据处理在构建和训练复杂的神经网络模型中的核心作用。这些模型,如最新的Transformer架构,通过成百上千亿个参数能够准确理解和生成人类语言,从而推动了自然语言处理(NLP)和人工智能(AI)领域的飞速发展。它们不仅能够执行传统的文本翻译和摘要任务,而且在情感分析、问答系统、写作辅助等高级应用场景中展示出惊人的能力。更进一步,大模型理论基础的探究还在拓展到其他模态的学习,如计算机视觉和多模态学习,展现出跨领域应用的巨大潜力。除此之外,它们也为理解人脑如何处理和理解信息提供了新的视角,推动了人机协作和智能系统的创新。

模板推荐

作者其他创作

大纲/内容

Collect

Collect

Collect

Collect

0 条评论

下一页