论文技术路线

2025-05-29 21:39:32 146 举报

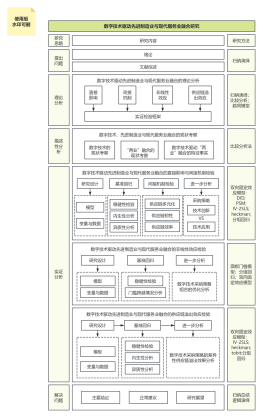

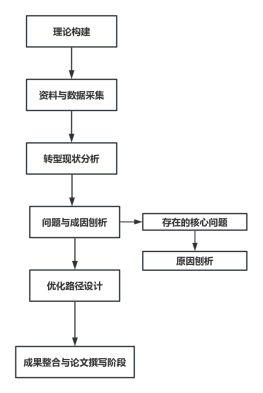

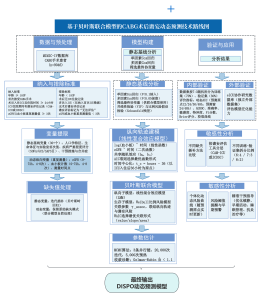

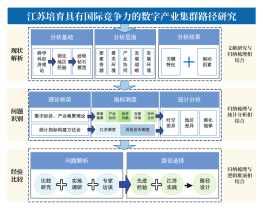

本论文的技术路线聚焦于深度学习领域,旨在提升自然语言处理模型的性能与效率。研究采用了混合神经网络架构,结合了长短时记忆网络(LSTM)与Transformer架构,以实现对文本的深层语义理解。通过精心设计的层序注意力机制,模型能够专注于输入数据的关键部分,从而提高学习任务的准确性。此外,研究采用了多任务学习框架,使得模型能在多种相关任务上进行共享和迁移学习,进一步优化学习效率和模型泛化能力。本研究在多个人工智能基准测试数据集上进行了全面验证,证明了所提技术路线的有效性和先进性。论文最后详细记录了实验过程,讨论了结果,并对未来的改进方向和应用前景进行了展望。本文档为PDF格式,技术术语的精确使用和丰富的图表修饰使得叙述更加生动与专业。

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页