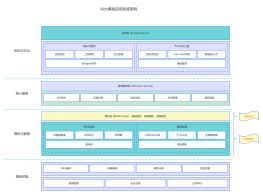

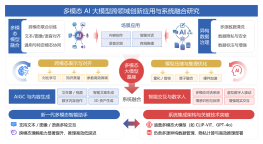

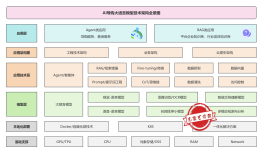

大学新生:AI大模型本地部署

2025-09-06 13:58:33 0 举报

AI智能生成

大学新生:AI大模型本地部署

模板推荐

作者其他创作

大纲/内容

Collect

Collect

Collect

Collect

0 条评论

下一页