云原生核心架构技术体系

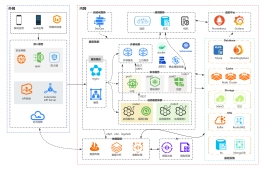

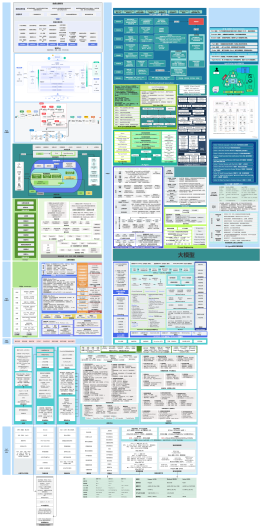

2026-04-26 10:41:27 0 举报云原生核心架构技术体系是一种以容器化部署、微服务、持续集成/持续部署(CI/CD)和声明式基础设施等为核心要素的先进技术理念。它旨在构建和运行可弹性扩展的应用程序,并充分利用云计算的潜力,实现高效的资源利用、快速的迭代部署以及灵活的云平台管理。

AI

容器

Volcano

模板推荐

作者其他创作

大纲/内容

测试

Oracle

Volcano 通过统一调度系统,实现了两类核心工作负载的全量支持:AI / 大数据 / 高性能计算批处理负载:通过 VcJob 原生支持 Ray、TensorFlow、PyTorch、MindSpore、Spark、Flink、MPI 等主流框架,提供批处理场景专属的增强调度能力;Kubernetes 原生工作负载:可直接调度 Deployment、StatefulSet、原生 Job、DaemonSet 等所有 K8s 内置工作负载,完全兼容原生调度语义

- operation3(params)

数据资产

CDL

Alertmanager(告警管理器)

优炫数据库 UXDB

GoldenDB

(4)分布式锁解决跨服务的并发资源竞争问题,如库存扣减、活动库存抢占。核心设计要求:互斥性、防死锁、高可用、可重入、自动释放。主流选型:Redisson(Redis 分布式锁,适用绝大多数场景)、etcd/ZooKeeper(强一致性场景)。

AI 场景专属安全与合规能力

二、核心增强功能Volcano Global 在 Karmada 基础上,针对 AI 场景提供了专属调度能力,核心包括:Volcano Job 原生跨集群调度:原生支持 Volcano Job 的跨集群部署与调度,可充分利用多集群的分散资源,提升大规模 AI 任务的执行效率。跨集群全局队列优先级调度:支持跨集群的队列优先级统一管理,保障高优先级队列的任务优先获取全局集群资源。作业级优先级与排队机制:在多集群环境中,支持作业维度的优先级调度、排队管控,确保核心业务的关键任务可及时执行。跨集群多租户公平调度:提供全局的多租户公平调度能力,保障不同租户间的资源分配公平合理,避免跨集群的资源争用问题。

分布式缓存(Redis/Tair):主从复制 + 哨兵集群 + 分片集群架构,多可用区部署,自动主备切换;缓存穿透 / 击穿 / 雪崩防护策略消息队列(Kafka/RocketMQ):Broker 集群化部署,多副本 ISR 同步,Controller 自动选主,故障节点自动剔除分布式协调组件(etcd/ZooKeeper):基于 Raft/Paxos 一致性协议的集群部署,过半节点存活即可提供服务,多可用区部署,自动选主

DevOps

一、背景与核心目标场景痛点:大模型训练的模型并行场景下,多节点需要高频大量数据交互,节点间网络传输性能成为训练核心瓶颈;数据中心网络(IB/RoCE/NVSwitch 等)拓扑复杂,节点跨交换机层级越多,通信延迟越高、吞吐量越低。核心目标:将训练作业调度到通信效率最优的网络性能域,尽可能减少跨交换机通信,加速数据交换,提升训练效率;同时屏蔽不同网络类型的差异,降低拓扑管理的复杂度。

自动化测试、质量分析JUnit、PyTest、SonarQube

+ operation1(params):returnType

腾讯云 EMR + TCHouse-D

DM

底层设计原则

服务自治原则(微服务的生命线)

一、核心定位与目标解决 AI 场景 GPU 资源利用率不均衡的行业痛点:小型推理 / 轻量训练负载单 GPU 资源浪费,大规模负载算力未充分挖掘;通过 vGPU 能力实现 GPU 资源的灵活分配,大幅提升集群 GPU 利用率、降低算力成本,同时兼容不同硬件能力与业务性能需求。

Hudi

SmallFS

数据层

PG

队列资源管理

token 级精细化观测:统计每一次请求的输入 / 输出 token 数、token 消耗成本、对话轮次的 token 累计;

五大场景:同城灾备、异地容灾、同城多活、两地三中心、异地多活组合方案:混沌工程常态故障演练、全链路性能压测、分钟级拨测探活、可编排容灾多活自动切换、可观测大屏形成完整高可用攻防系统,多活秒级RTO、容灾分钟级RTO编排基座:可编排容灾多活切换流程、动作、检查点和插件,一键自动切换专业服务:咨询+架构诊断+多活容灾实施方案+故障演练+友商搬迁权威认证:MAS应用多活、CPTS全链路性能压测、 CAST-ARS混沌工程三大核心能力获得中国信通院先进级最高权威认证和业界最佳实践

可视化可观测Grafana

机器学习

Kafka

GaussDB

功能:支持按照crontab定时任务和固定时间间隔进行重调度用户可以把Volcano descheduler部署为一个Deploment类型的工作负载。然后在命令行参数指定按照cronTab定时运行或者固定时间间隔运行重调度组件,而无需把重调度组件部署成一个cronJob类型的工作负载。支持基于真实负载感知的重调度LoadAware在K8s集群治理过程中,常常会因CPU、内存等高使用率状况而形成热点,既影响了当前节点上Pod的稳定运行,也会导致节点发生故障的几率的激增。为了应对集群节负载不均衡等问题,动态平衡各个节点之间的资源使用率,需要基于节点的相关监控指标,构建集群资源视图,在集群治理阶段,通过实时监控,在观测到节点资源率较高、节点故障、Pod 数量较多等情况时,可以自动干预,迁移资源使用率高的节点上的一些Pod到利用率低的节点上。原生的descheduler只支持基于Pod request的负载感知调度,对利用率比较高的节点上的Pods进行驱逐,从而均衡节点间的资源利用率,避免个别节点过热。但是Pod request并不能反映节点的真实资源使用情况,因此Volcano实现了基于节点真实负载的重调度,通过查询节点暴露的指标,基于CPU、Memory的真实负载进行更加准确的重调度。

Queuequeue是容纳一组podgroup的队列,也是该组podgroup获取集群资源的划分依据

数据集成数据标准

多模型与异构算力智能调度

算力调度引擎 Volcano

Enhanced OS:Volcano SLO Agent在应用层进行节点级别的QoS保证,为了进行更加精细化和强制性的隔离,内核层面也需要区分QoS类型,在CPU/Memory/Network/L3 cache等层面进行隔离,内核暴露了一系列的cgroup接口,Volcano SLO Agent可以为在线和离线业务设置不同的cgroup,做到内核层面的精细隔离,实现在线作业对离线作业的压制。

SQLServer

云监控服务

数据库

限流:拦截超出系统承载能力的流量,核心算法:令牌桶、漏桶、滑动窗口;熔断:当依赖服务错误率超过阈值,自动切断调用,快速失败,避免故障向上游扩散;降级:故障或流量高峰时,关闭非核心功能,释放资源保障核心链路可用;隔离:通过舱壁模式、线程池隔离,避免单个服务故障耗尽全局资源;

运维

三、核心功能能力1. 拓扑感知智能调度策略支持两种调度约束模式:hard 硬约束:作业任务必须部署在同一个 HyperNode 内soft 软约束:优先将作业调度到同一个 HyperNode 内,无法满足时也允许跨域调度,兼顾性能与调度灵活性。2. HyperNode 自动发现能力支持多种数据源:原生适配 UFM(IB 网络管理平台)、RoCE、节点标签等发现源,可直接适配昇腾 GPU/NPU 集群的拓扑结构;核心特性:自动发现并同步集群网络拓扑,自动创建 / 更新 / 删除 HyperNode CR,支持自定义 Discoverer 插件扩展,可配置发现间隔与访问凭据。

...

高可靠

异构算力精细化调度

多集群AI作业调度

工具调用权限控制:针对 Agent 的工具调用设置细粒度的访问策略,防止越权调用。

(6)容错与弹性能力面向失败设计的核心落地,构建「限流→熔断→降级→隔离」四层纵深防御体系,避免系统雪崩。限流:拦截超出系统承载能力的流量,核心算法:令牌桶、漏桶、滑动窗口;熔断:当依赖服务错误率超过阈值,自动切断调用,快速失败,避免故障向上游扩散;降级:故障或流量高峰时,关闭非核心功能,释放资源保障核心链路可用;隔离:通过舱壁模式、线程池隔离,避免单个服务故障耗尽全局资源;主流选型:Sentinel、Resilience4j。

云原生混部

多模型统一接入:兼容 OpenAI、Anthropic、开源大模型等主流模型的 API 规范,提供统一的调用入口,实现业务无感知的模型切换;

数据集成

基础设施层(HCS、BMS、容器、专属服务器)

混沌工程持续验证主动注入故障(如机房断电、网络中断、节点宕机、数据库故障),模拟真实故障场景,端到端验证全链路的高可用能力,提前发现系统隐患,避免故障在真实场景中发生。

负载均衡:支持加权轮询、最小连接数、一致性哈希等多种算法,实现细粒度的请求分发;

部署

完整继承传统服务网格的 mTLS 加密、身份认证、访问控制能力。

多级队列资源借用 / 回收 / 抢占多租户强隔离

项目管理、需求跟踪Jira、Trello

数据接入

多云 / 多集群模型统一治理:实现跨环境、跨平台的模型服务互通与统一管理。

核心流量治理能力

构建工具、依赖管理Maven/Gradle/npm/Yarn

Ranger

DevOps生命周期

全 K8s 兼容全训推框架支持在离线混部多集群调度(Global)

全链路安全防护能力

镜像Image

AI 原生全链路可观测性

Flume

(5)分布式事务解决跨服务、跨库的数据一致性问题,是微服务架构的核心难题,核心遵循「BASE 理论」,优先柔性事务,避免强一致性 2PC 带来的性能损耗。

Overlay 网络:Flannel/Calico/Weave Net(跨云、加密)/CiliumUnderlay网络:IPvlan/Macvlan/SR-IOV

高可用

容器网络接口CNI

全栈智能可观测平台

多活容灾架构按业务等级适配不同架构,核心业务推荐单元化异地多活架构:将业务拆分为多个独立单元,每个单元包含完整的应用、中间件、数据库,单元内业务闭环;单单元故障时,流量自动切换到其他单元,实现地域级故障的无感知恢复,核心业务可达到 RTO<5 分钟、RPO=0 的容灾目标。配套两地三中心、三地五中心的部署模式,实现同城双活、异地灾备的分级容灾。

应用性能管理

Yarn

黄金指标监控:自动采集服务的延迟、流量、错误率、饱和度四大核心指标;

规划

容器网络类型桥接网络(Bridge Network)/主机网络(Host Network)/无网络(None Network)/自定义网络(Custom Network)

核心调度能力

容器引擎/编排工具/配置管理Docker/K8S/Nacos...

整个云原生混部架构主要包括Volcano Scheduler、Volcano SLO Agent、Enhanced OS几部分。

文件

华为云 FusionInsight MRS 离线计算引擎

DDD 领域驱动设计(拆分的唯一核心依据)

三、核心设计原则

星环科技 TDH

数据质量

大模型推理专属流量治理

统一 API 密钥管理:支持多模型提供商的 API 密钥统一托管,以及细粒度的权限与配额控制;

流处理引擎Flink

面向失败设计原则

云原生大数据计算平台 + 离线数仓引擎

容灾备份

批处理引擎Spark

Volcano 提供两种 GPU 共享模式,适配不同场景,集群可同时部署两种模式的节点,支持异构集群统一调度,核心对比如下:HAMI-core(软件级 vGPU):基于 VCUDA(CUDA API 劫持技术),在软件层限制 GPU 核心与显存的使用,实现虚拟 GPU 切片Dynamic MIG(硬件级 GPU 切片):基于 NVIDIA MIG 原生技术,将单张物理 GPU 切分为多个硬件级隔离的独立实例

统一元数据管理&统一权限管理

RocketMQ

数据治理体系

核心特性1. 三级精细化资源配额控制支持 CPU、内存、GPU/NPU 等多维度资源配额,通过三级参数实现资源的保障、弹性与上限管控,核心配置规则与含义如下:guarantee:资源预留量,仅当前队列可用,其他队列无法占用,是队列的资源保障下限;deserved:资源应得量,集群资源紧张时队列可稳定获得的资源量;集群空闲时可借用其他队列的空闲资源,资源紧张时超出该值的超额资源会被回收capability:资源使用上限,队列可占用的最大资源量,是资源占用的天花板2. 多层级队列管理支持树状多层级队列结构,兼容 Yarn 式的资源管理模式,便于大数据工作负载向 Kubernetes 迁移;实现父子队列间的资源继承、隔离,支持跨层级的资源共享与回收。3. 智能资源弹性调度资源借用:允许队列使用其他队列的空闲资源,最大化集群整体资源利用率;资源回收:集群资源紧张时,优先回收其他队列超出 deserved 值的超额资源,保障队列的应得资源;资源抢占:支持队列内高优先级作业抢占低优先级作业的资源,确保关键任务及时执行。4. 多租户安全隔离通过严格的配额管控、基于优先级的资源分配,防止单个租户过度占用集群资源,实现租户间的资源隔离与公平调度。

AI-服务网格(Service Mesh)

- operation2(params)

OLAP集市Doris

AI 芯片调度与虚拟化资源配额、隔离、超配GPU动态切分、共享

版本控制、代码审查Git/GitHub/GitLab

治理诉求

物联网IoT

数据开发

流量控制:内置熔断、降级、限流、重试、超时控制、故障注入、流量镜像等能力,保障服务可靠性;

华为云 FusionInsight:自研湖仓引擎

Prometheus

全量访问审计日志,满足合规与溯源需求。

数据面

(8)落地保障:云原生部署与运维架构微服务的大规模落地,必须依托云原生基础设施,否则运维成本会指数级上升。容器化部署:基于 Docker 实现服务的环境一致性打包,一次构建、到处运行,解决开发与生产环境不一致的问题。容器编排:基于 Kubernetes 实现服务的自动化部署、弹性扩缩容、故障自愈、滚动更新,解决大规模服务集群的运维难题。CI/CD 流水线:基于 Jenkins、GitLab CI、ArgoCD 构建持续集成 / 持续交付流水线,实现代码提交→自动化测试→构建→部署→回滚的全流程自动化,大幅提升迭代效率。环境管理:严格隔离开发、测试、预发、生产环境,通过配置中心、环境变量实现环境差异化配置,保证环境一致性。

混沌工程

会话与状态管理:针对多轮对话、长会话场景的状态保持与会话生命周期管理;

Agent 调用链容错:支持工具调用失败的自动重试、降级、熔断,保障多步推理的稳定性;

用量与成本预测:基于历史调用数据,预测 token 消耗与推理成本,辅助资源规划。

服务网格

弹性与溢出调度:联动 K8s 实现模型实例的弹性扩缩容,支持本地算力不足时,自动将溢出请求路由到云端模型 API;

ICAN容器隧道网络

原生支持服务发现与健康检查,适配 Kubernetes 等容器编排平台;

Volcano SLO Agent:集群内的每个节点都会部署一个Volcano SLO Agent,动态实时计算每个节点已经分配但未使用的资源,将这部分资源进行超卖,供离线作业进行使用。同时对节点QoS进行保障,在检测到节点出现CPU/Memory压力时,对离线作业进行驱逐,保障在线业务的优先级。

阿里云湖仓一体:Delta Lake、ADB

1. 无状态化设计:服务会话统一存储到分布式缓存,无本地状态依赖,支持任意扩缩容与故障节点快速替换;2. 服务网格(Service Mesh):通过 Sidecar 实现服务间熔断、降级、重试、故障隔离,与业务代码解耦,自动剔除故障服务节点;3. 弹性伸缩能力:基于 CPU / 内存 / 请求量的 HPA/VPA,以及事件驱动的 KEDA 弹性扩缩容,应对流量波动;Serverless 架构实现按需实例化,极致弹性保障;4. 安全发布策略:蓝绿发布、灰度发布、滚动发布,配套一键回滚机制,将发布故障的影响范围降到最低;5. 故障隔离模式:舱壁模式隔离服务依赖,避免单个服务故障导致的全链路雪崩;异步解耦通过消息队列削峰填谷,减少服务强依赖。

KMS

业务库

微服务架构

动态路由:支持金丝雀发布、A/B 测试、灰度发布,按请求头、权重、路径等规则实现精细化流量分发;

AI 全链路追踪:覆盖「用户请求→AI Agent→大模型→向量数据库→工具调用」的完整链路,还原每一个环节的延迟、错误、资源消耗;

Volcano Scheduler:负责在离线作业的统一调度,提供队列、组、作业优先级、公平调度、资源预留等多种抽象,统一满足微服务、大数据、AI等业务调度需求。

南大通用 GBase

LakeFormation

简单检索HBASE

2. 流量调度与负载均衡层:请求分发的中枢核心目标:实现请求的精细化路由、故障自动转移,避免单点故障传导到后端业务。

机房高可用:多可用区(AZ)部署,每个 AZ 具备独立的电力、制冷、网络,AZ 之间低延迟互联,单 AZ 故障不影响全局;双路市电 + UPS 不间断电源 + 柴油发电机备份,精密空调 N+1 冗余,避免机房级故障。网络高可用:叶脊(Spine-Leaf)无阻塞网络架构,设备双上联、链路聚合(LACP),BGP 路由冗余,避免网络单点故障;RDMA 高速网络适配 AI / 大数据场景,保障低延迟通信。服务器高可用:服务器双电源、双网卡、RAID 卡冗余,避免硬件单点故障;虚拟化层 HA 机制,宿主机故障自动迁移虚拟机,热迁移实现无感知运维。异构算力高可用:GPU/NPU 集群化管理,故障节点自动隔离,算力弹性调度,保障 AI 训推业务的稳定运行。

容器

推理性能专属指标:采集首包延迟(TTFT)、每 token 生成延迟(TPOT)、推理吞吐量、GPU/NPU 算力利用率等 AI 核心指标;

推理成本优化能力

二、核心设计:HyperNode 标准化拓扑 APIVolcano 通过自定义 CRD HyperNode 实现网络拓扑的标准化表达,解决传统节点标签方式语义不统一、拓扑表达不精准的问题,核心特性如下:树状层级结构:一个 HyperNode 对应一个网络性能域(通常映射为交换机 / Tor),叶子 HyperNode 关联集群真实节点,非叶子 HyperNode 关联其他 HyperNode,形成层级化拓扑;节点通信效率由 HyperNode 层级跨度决定,层级越低、跨度越小,通信效率越高。

服务间双向 TLS(mTLS)加密,实现通信链路的全程加密;

全链路故障自愈体系构建从基础设施到应用层的自动化故障处理闭环:秒级健康检测 + 故障根因分析→自动执行故障隔离(流量切走、节点摘除)→自动恢复(实例重建、主备切换、弹性扩缩容),全程无需人工干预,大幅缩短故障停机时间。

容器引擎(Container)Docker、Containerd、CRI-O、Podman、runc...

推理 QoS 保障:按租户 / 用户 / 应用设置请求优先级、token 配额、调用频率限流,支持请求排队与公平调度,防止资源抢占;

集群管理

推理缓存:内置 Prompt 缓存、KV 缓存,相同或相似请求直接返回缓存结果,大幅降低 token 消耗与推理延迟;

业务价值优先原则

混沌工程(Chaos Engineering)是一种通过主动注入故障识别并修复系统未知隐患的工程实践。MAS-CAST混沌工程服务提供丰富的故障模式库,通过混沌实验编排攻击目标、攻击策略进行故障注入,支持添加背景流量和资源监控,同时在故障注入能力的基础上,通过体系化的流程和规范来创建故障演练,从而验证和提升系统可靠性和技术团队应急响应能力。

Exporters(导出器)

5. 数据存储层:业务的核心底座核心目标:是高可靠的核心阵地,同时保障存储服务的持续可用,实现数据 “不丢、不错、可访问”。

仓库Repository

1. 接入层:请求入云的第一道关口核心目标:保障用户请求能稳定、安全地进入云环境,避免接入侧故障导致全局服务不可用。

(2)配置中心实现配置的集中化管理、动态更新,无需重启服务。核心设计要点:多环境隔离、配置灰度发布、权限管控、配置回滚、敏感配置加密、变更审计。主流选型:Nacos、Apollo。

OBS

数据湖统一存储

成本控制策略:支持高峰时段自动模型降级(如从高规格模型切换到低成本模型)、闲置算力复用、预算管控等能力;

中间件

存储格式:Parquet、ORC、Hudi

一、背景与核心目标场景痛点:单 Kubernetes 集群无法满足大规模 AI 训练、推理任务的资源需求,企业多集群管理场景下,缺乏针对 AI 负载的跨集群统一调度、全局资源管控能力。核心定位:Volcano Global 是 Volcano 社区孵化的专用子项目,基于 Karmada 构建,为多集群 AI 任务提供统一调度平台,实现跨集群的 AI 工作负载分发、资源管理、优先级与公平调度。

无单点原则:所有组件、链路、硬件都必须实现冗余部署,消除任何单点故障。故障隔离原则:通过单元化、舱壁模式、限流熔断,避免故障在链路中传导,缩小故障影响范围。自动化优先原则:故障的检测、隔离、恢复全部自动化,减少人工操作的失误与延迟。冗余与成本平衡原则:根据业务等级制定差异化的高可用 / 高可靠策略,核心业务极致保障,非核心业务平衡成本与可用性。持续验证原则:通过混沌工程、备份恢复演练,常态化验证高可用能力,避免架构设计与实际能力脱节。

基础设施层

YangtseVPC路由网络

(7)排障核心:可观测性体系设计微服务是分布式部署,传统监控无法定位跨服务故障,必须构建完整的可观测性体系,核心是三大支柱:日志:统一日志格式、全链路 TraceID 透传、日志分级、敏感数据脱敏,通过 ELK/EFK 实现日志聚合与检索,实现跨服务日志关联。指标:基于四大黄金指标(延迟、流量、错误率、饱和度)、RED 方法(请求率、错误率、耗时)构建监控体系,选型 Prometheus+Grafana,配置分级告警策略,避免告警风暴。全链路追踪:通过 SkyWalking、Jaeger 等组件,追踪请求的全链路调用过程,可视化调用拓扑、耗时分布、异常节点,快速定位性能瓶颈与故障根因。

Pushgateway

服务网格(Service Mesh)

RabbitMQ

容错与弹性能力

异构算力路由:根据请求类型自动匹配最优算力资源,比如低延迟推理请求调度到 GPU 节点,批量离线任务调度到 CPU / 低成本算力节点;

关系型数据库(MySQL / 分布式数据库):基于 Raft/Paxos 的多副本集群架构,多可用区部署,RPO=0 的秒级主备切换;读写分离、分库分表,解决单库性能瓶颈;数据库 Proxy 实现故障自动路由对象存储(S3 兼容):集群化部署,元数据节点高可用,就近接入与多活访问,单节点故障自动修复块存储 / 分布式文件存储:存储双活架构,多路径链路冗余,故障自动切换;存储集群化部署,数据自动均衡

腾讯云 湖仓一体:Iceberg、Spark

云原生网络

湖仓一体

数据仓库

数据服务

高可用高可靠(HA和HR)

可观测链路

业务层

VolcanoJobVolcano Job,简称vcjob,是Volcano自定义的Job资源类型。区别于Kubernetes Job,vcjob提供了更多高级功能,如可指定调度器、支持最小运行pod数、 支持task、支持生命周期管理、支持指定队列、支持优先级调度等。Volcano Job更加适用于机器学习、大数据、科学计算等高性能计算场景。

监控、日志、追踪Prometheus/Grafana/ELK

云原生数据湖

推理场景容错:针对长上下文推理、多轮对话的重试、超时、熔断降级策略,避免单次请求失败影响全链路。

Cron VolcanoJobspan style=\"font-weight:normal;\

Grafana(可视化)

微服务-服务网格(Service Mesh)

全链路可观测性构建「指标 + 链路 + 日志」三位一体的可观测体系:通过 Prometheus 实现全链路黄金指标监控,SkyWalking/Jaeger 实现分布式链路追踪,ELK 实现日志统一检索;配套智能告警、根因分析能力,实现故障的提前预警与快速定位,将 MTTR(平均故障恢复时间)降到最低。

HDFS

统一资源调度

滚动升级

控制面

分布式链路追踪:原生集成 Jaeger、Zipkin 等工具,实现服务调用全链路追踪;

多租户&队列资源管理

数据安全

(3)接口幂等性设计微服务网络不可靠,重试是常态,必须保证接口重复调用结果一致,避免重复下单、重复扣款等业务故障。核心方案:唯一请求 ID + 去重表、乐观锁、分布式锁、状态机约束、Token 令牌机制。强制要求:所有写接口必须实现幂等性。

编码

Client Libraries(客户端库)

Istiod管理面、Linkerd Control Plane、Consul Connect• 服务发现;• 配置下发;• 证书管理;• 可观测性集成

Volcano 的统一调度能力,核心是打造单调度器全负载覆盖的调度体系,在完全兼容 Kubernetes 原生调度能力的基础上,扩展了面向 AI、大数据、高性能计算场景的批处理调度能力,实现用一套调度系统管理集群内所有类型的工作负载,大幅简化集群调度运维复杂度。

1. 转发规则持久化与多副本同步:负载均衡配置实时同步到集群所有节点,单节点故障不丢失配置;2. 请求全链路追踪:透传 TraceID,实现请求从接入到后端的全链路可追溯。

湖内分析

4. 中间件层:应用与数据的桥梁核心目标:保障缓存、消息、协调组件的持续可用,同时避免中间件故障导致的数据丢失。

统一调度与生态兼容

容器存储容器存储接口(CSI)动态存储供应声明式API与控制循环

复杂搜索ES

阿里云 ACK:Terway

DataOps

数据源

腾讯云 TCHouse-P

交互式分析HetuEngine

控制面(Control Plane)kube-apiserver:认证、授权、准入控制etcd:存储集群关键状态:Pod配置、Service规则、用户权限kube-scheduler:自定义调度策略(亲和性、误点、容忍、资源配额限制)、资源状态、资源需求、动态调整分配逻辑kube-controller-manager: Deployment 控制器、 StatefulSet 控制器、 Node 控制器、Service 控制器cloud-controller-manager:对接云厂商 API、负载均衡、对象存储等控制面辅助组件:HaProxy/NGINX、kube-aggregator

跨环境服务治理能力

MySQL

高内聚低耦合原则

高可靠(HR):聚焦数据不丢失、不损坏、一致性的能力,核心目标是保障数据安全与完整性,通常用数据持久性(如 11 个 9)衡量,核心是数据冗余、备份与一致性保障。

批量作业全生命周期管理

数据面(Data Plane)Kublete:Pod生命周期管理、健康检查机制(存活探针、就绪探针)、监控Pod状态kub-proxy:负载均衡和网络规则转发:iptables、ipvsContainer Runtime:容器资源隔离机制、镜像管理、与kubelet通信CNI插件:容器网络连通(容器网络模型)CSI插件:存储对接(创建、挂载、扩容、快照等)Ingress Controller:反向代理服务器(如 Nginx)、HTTPS解密、路径重写、负载均衡、访问控制

基于 SPIFFE 标准的服务身份认证,以及细粒度的服务访问授权策略(RBAC);

治理价值体现

分布式事务

阿里云 AnalyticDB(ADB)

VolcanoJob(VcJob)增强型批量作业PodGroup容错与自愈作业流编排

网络拓扑感知调度

核心能力:关键技术模块设计

容器隔离机制Namespace(环境隔离)+Cgroups(资源限制)

多样集市

RAG 场景优化:支持向量数据库调用的缓存、路由优化,提升检索效率;

1.Gang 成组调度2. 拓扑感知调度3.调度策略插件

二、跨层全局架构设计(通盘保障的核心)单一层的高可用无法实现端到端的保障,必须通过全局架构设计实现全链路的协同容灾与故障隔离。

Manager

金仓数据仓库(KingbaseDW)

(1)服务注册与发现:解决大规模服务的地址动态管理、健康检查、流量调度问题。核心设计要点:服务启动时自动注册,下线时自动注销;心跳健康检查,自动剔除故障节点;同机房优先调度,降低网络延迟;支持多集群容灾、灰度路由。主流选型:Nacos(国内首选,注册 + 配置一体化)、Eureka、Consul。

智能路由:支持基于模型名称、API 版本、用户等级、token 消耗、推理延迟(TTFT/TPOT)、算力负载的精细化路由,以及多模型提供商的自动故障切换;

背景:集群中的调度是将pending状态的Pod分配到节点运行的过程,Pod的调度依赖于集群中的调度器。调度器是通过一系列算法计算出Pod运行的最佳节点,但是Kubernetes集群环境是存在动态变化的,例如某一个节点需要维护,这个节点上的所有Pod会被驱逐到其他节点,但是当维护完成后,之前被驱逐的Pod并不会自动回到该节点上来,因为Pod一旦被绑定了节点是不会触发重新调度的。由于这些变化,集群在一段时间之后就可能会出现不均衡的状态。

服务拓扑可视化:自动生成服务依赖关系拓扑,直观呈现服务调用关系。

渐进式演进原则

3. 应用与服务层:业务逻辑的承载层核心目标:保障业务服务的持续可用,避免业务逻辑故障导致的服务中断。

Prometheus Server

Envoy:Istio数据面/Linkerd 默认、HAProxy、Nginx• 流量代理:◦ 负载均衡算法;◦ 路由匹配• 安全通信:◦ 自动加密;◦ 身份认证;• 故障恢复:◦ 熔断;◦ 重试;◦ 超时控制• 数据收集:◦ 指标收集;◦ 日志收集;◦ 调用链追踪

图GES

管理中心

Redis

微服务管理服务网格、Istio

AI 工作流与 Agent 治理能力

容器网络模型

国产数据库

成本可视化:按模型、租户、部门、接口统计推理成本,支持成本分摊与预算预警。

容器网络

开箱即用的可观测性

Volcano(底层算力调度引擎)

CI/CD 平台、部署工具Jenkins、GitLab CI

腾讯云TKE:VPC-CNI

Oozie

三、核心架构与组件Volcano Global 基于 Karmada 的多集群资源分发框架构建,核心包含两个组件,调度流程如下:Volcano Webhook:监听 ResourceBinding 资源的创建事件,将该资源设置为暂停状态,拦截 Karmada 的默认分发流程,为调度判断提供前置控制。Volcano Controller:核心调度执行组件,监听处于暂停状态的 ResourceBinding,基于作业所属队列的优先级、作业自身的优先级,执行优先级调度、公平调度逻辑,同时运行资源准入校验;准入通过后,解除 ResourceBinding 的暂停状态,交由 Karmada 完成后续的跨集群资源分发。(Karmada 负责提供多集群的基础资源管理、应用分发框架、跨集群调度底座;)

Volcano GPU 虚拟化能力

华为云GaussDB(DWS)

https://support.huaweicloud.com/usermanual-cce/cce_10_0423.htmlhttps://volcano.sh/zh/docs/

发布

阿里云MaxCompute

分布式缓存(Redis/Tair):混合持久化(RDB+AOF),数据定时备份,跨实例数据同步,防止缓存数据丢失导致的数据库压力过载消息队列(Kafka/RocketMQ):消息同步刷盘持久化,多副本冗余,消息重试与死信队列,事务消息保障分布式一致性,防止消息丢失分布式协调组件(etcd/ZooKeeper):数据持久化,定时快照备份,元数据多副本同步,保障配置、服务发现信息的一致性

监控

PodGrouppodgroup是一组强关联pod的集合,主要用于批处理工作负载场景,比如Tensorflow中的一组ps和worker。它是volcano自定义资源类型。

1. 接口幂等设计:避免重试导致的数据重复与异常;2. 分布式事务保障:基于 TCC/SAGA/XA 模式实现跨服务数据一致性;3. 业务日志全量留存:操作日志、异常日志持久化存储,支持故障溯源与数据回滚。

精细化监控

构建

Spring Cloud Alibaba 技术栈

高可用(HA):聚焦系统持续提供服务的能力,核心目标是减少非计划停机时间,通常用服务可用性 SLA(如 99.99%)衡量,核心是故障的快速发现、隔离与自愈。

实时同步

全链路审计:全量记录 Prompt 输入、模型输出、调用者身份、token 消耗、算力使用情况,满足等保与行业合规要求;

时序IoTDB

请求批处理:聚合零散的推理请求,提升 GPU 算力利用率,降低单位推理成本;

主数据

流式协议优化:原生兼容 SSE、WebSocket 等大模型流式推理协议,保障长连接、流式响应的稳定性;

多协议支持:原生兼容 HTTP/1.1、HTTP/2、gRPC、TCP 等主流服务通信协议。

支持多集群、多可用区、多云环境的服务互通与统一治理。

DBService

Superrior

OB

关系型数据库(MySQL / 分布式数据库):全量备份 + 增量 binlog 备份,定时快照,跨地域备份,备份恢复常态化演练;闪回查询、数据校验,ACID 事务保障数据一致性对象存储(S3 兼容):多副本 / EC 纠删码冗余,跨可用区 / 跨地域数据复制,数据持久性可达 11 个 9 以上;版本控制、WORM、回收站机制,防止误删除;数据校验与自动修复块存储 / 分布式文件存储:三副本实时同步,快照备份,远程复制,数据加密,坏盘自动数据重建

1. 全局负载均衡(GSLB):跨地域、跨可用区的全局流量调度,结合秒级健康检查,自动将流量从故障区域切走,实现跨区域容灾;2. 4 层 / 7 层分离负载均衡:4 层(LVS/DPVS)基于 DPU/DPDK 硬件加速,实现高性能转发,集群主备 / 多活部署;7 层(Ingress/NGINX)实现路径、请求头精细化路由,支持灰度 / 金丝雀发布,缩小发布故障影响范围;3. 全链路流量治理:分布式限流(令牌桶 / 漏桶算法)、熔断降级、请求重试与超时控制,防止突发流量打垮后端服务,避免级联雪崩;4. 故障注入与流量镜像:通过混沌测试主动验证调度能力,提前发现可用性隐患。

日志服务ELK

实时宽表分析ClickHouse

内容安全防护:内置 Prompt 注入攻击检测、恶意输入过滤、输出内容合规审核、敏感数据防泄漏(DLP)能力;

1. 全链路 TLS 加密:请求传输全程加密,防止数据劫持与篡改;2. 接入层审计日志:全量请求日志留存,满足溯源与合规要求;3. 证书自动化管理:证书自动续期、分发,避免证书过期导致的服务不可用。

K8S

二、Kubernetes 原生调度能力的兼容与增强Volcano 通过predicates和nodeorder两个核心调度插件,完整对齐 K8s 原生调度框架的全流程,同时针对批处理场景做了深度性能与能力增强。1. predicates 插件:预过滤 / 过滤阶段兼容与增强该插件完整实现了 Kube-Scheduler 的预过滤 - 过滤全流程,同时提供专属增强特性:原生兼容能力:覆盖基础资源过滤、节点 / Pod 亲和性与反亲和性、节点端口 / 存储卷约束、Pod 拓扑分布约束、K8s 动态资源分配 DRA 等所有原生过滤规则;增强特性 1:节点过滤结果缓存:针对批量相同配置 Pod 的调度场景,缓存节点静态检查结果(节点标签、污点等),避免重复计算,显著提升大规模批量任务的调度性能;动态资源(CPU、内存用量)检查仍会实时计算,节点状态变化时缓存自动失效;增强特性 2:完整支持 DRA 动态资源分配:支持 GPU 等硬件资源的灵活请求、分配与共享,提供了从容器运行时配置、K8s APIServer 启用、Volcano 特性门控开启到调度插件配置的全流程支持,可对接 NVIDIA、Intel 等厂商的官方 DRA 驱动。2. nodeorder 插件:打分阶段兼容与增强该插件在完全兼容 K8s 默认打分机制的基础上,实现了更灵活的调度策略与更高的调度效率:原生兼容能力:覆盖 K8s 所有原生打分维度,包括资源水位、亲和性、污点容忍、镜像本地性、拓扑分布等;核心增强 1:可配置权重体系:所有打分项均支持自定义权重,可灵活调整节点选择策略(如资源打散 / 打包、亲和性优先级等),适配不同业务场景;核心增强 2:并行打分处理:通过并行计算提升大规模集群的调度效率,尤其适配 AI 训练等批量任务的高并发调度需求。

队列是Volcano的核心概念之一,用于支持多租户场景下的资源分配与任务调度。通过队列,用户可以实现多租资源分配、任务优先级控制、资源抢占与回收等功能,显著提升集群的资源利用率和任务调度效率。

1. 多线 BGP 接入:对接三大运营商及中小运营商线路,解决跨运营商网络互通瓶颈,避免单运营商线路故障导致的接入中断;2. Anycast 任播技术:同一 IP 在多地域 / 多可用区发布,用户请求就近接入,单地域接入故障时自动切换到健康节点;3. 接入集群多活部署:LVS/NGINX/ 高防集群采用无状态化多活架构,单节点故障自动剔除,会话保持与转发能力无感知切换;4. 智能 DNS 调度:基于地理位置、运营商、节点健康状态的解析调度,故障节点自动摘除解析,配合 DNSSEC 防止 DNS 劫持;5. DDoS/CC 防护体系:云清洗中心、流量压制、源站防护,抵御大流量攻击导致的接入瘫痪。

批处理引擎Hive

消息

火山云ByteHouse

6. 基础设施层(IaaS):全链路的底座核心目标:为上层所有服务提供硬件、机房、网络的基础高可用与高可靠保障,是整个体系的基石。

Collect

Get Started

Collect

Get Started

Collect

Get Started

Collect

Get Started

评论

0 条评论

下一页