是一个重构的、内容寻址的记忆内存<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

连接是冗余的,即使这东西只有一部分模式呈交到自动协关器那里,模式的其余部分也将自动完成。从某方面说,此即心智的回忆。<br>

例:芹菜→开启“绿色”、“有叶子”→开启所有芹菜相关性质单位

连接是冗余的,即使这东西只有一部分模式呈交到自动协关器那里,模式的其余部分也将自动完成。从某方面说,此即心智的回忆。<br>

例:要回想起“蔬菜”,只要想到绿色和有叶的东西,或绿色和咬起来嘎吱作响的东西,或有叶的和咬起来嘎吱作响的东西<br>

例:能从一个词的几个零散部分推测出这个词,而非将其看做随机线段或任意序列的字母,而是将其看作一些更可能的东西<br>

在内容寻址的内存记忆中,确定某件东西自动会照亮记忆中包含了一个那东西复制品的位置。因为在自动协关器中表征一件东西是通过开启代表其性质的单位的,而这些单位都彼此很紧密地连接着,所以被激活的单位会相互强化,过了几轮后整个网络就都传遍了激活的信号,所有与这件东西相关的单位都将被锁止在“开”的位置。事实上,一个自动协关器的连接电储能支持许多组分量,所以它能<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>一次储存许多件东西。<br>

例:能从一个词的几个零散部分推测出这个词,而非将其看做随机线段或任意序列的字母,而是将其看作一些更可能的东西<br>

“优雅地降解”,有助于处理嘈杂的输入或硬件失灵<br>

使用占优势的相互一致的信息来压倒一个不寻常的信息<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>

例:“pritn”会激活更为熟悉的“print”模式<br>

能做一种简约版的计算,称为“限制性满意”<br>

假设解释一致的单位被连接到正电荷,解释不一致的被连接到负电荷,激活将会围绕着网络飞掠,若一切运转正常,它会确定在一个有最大数量相互一致的解释被激活的状态。<br>

例:听到的是元音[I]还是带南方口音的元音[e]:当听到“send/sinned a pen/pin”,会推断其为“send a pen”,因为“sinned a pin(犯罪的一只别针)”违反了语法规则和可理解的含义<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

有时一个约束网络可有相互不一致但相等的稳定状态。这说明了这个现象整体的模糊性,即以多种方式解释整个事物。网络中一致的单位(局部的解释)相互激活,不一致的相互抑制。<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>

例:观察立方体图时的视角<br>

网络自动归纳概括的能力

从概念上讲,若两个物体在某些方式上相似,那么它们很可能在其他方式上也相似<br>

任何几个单位的小集合都隐含地界定了一个级别,从而不同程度的包容级别被添加到相同的网络中。集合中<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>单位越少,级别越大。<br>

例:有“移动”、“呼吸”、“长毛发”、“吠叫”、“咬”、“见到消防栓就抬腿”这样的输出单位,发散出所有这六项的连接就触发有关狗的事实,发散出前三项的连接触发了关于哺乳动物的事实,发散出前两项的触发了关于动物的事实。只要有合适的权重,为一个动物设定的知识能既与它的直接家庭成员也与它的远亲成员共通使用。<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

由某些特征可推测出某些特征

从概念上讲,若两个物体在某些方式上相似,那么它们很可能在其他方式上也相似<br>

从物理上讲,相似的物体是由一些完全相同的单位所表征的,所以任何与一个单位的物体连接的信息事实上就会与其他物体的许多单位相连接<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

例:“长羽毛的”→(没有“鹦鹉”)→“温血”,即任何储存在对一个动物的连接中的事实(鹦鹉是温血的),自动地转移到类似的动物(虎皮鹦鹉是温血的),因为网络不在乎连接从属于任何一个动物<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>

从物理上讲,相似的物体是由一些完全相同的单位所表征的,所以任何与一个单位的物体连接的信息事实上就会与其他物体的许多单位相连接<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

从例子中学习,这些学习构成连接权重的变化<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>

假设“老师”将一个输入连同其正确输出供给一个模式协关器,学习机制将网络的实际输出(最初是很随机的)与正确输出相比较,并调整权重为二者的差异最小化。具有这种学习技术的模式协关器被称为一个感知器。<span id="transmark" style="display: none; width: 0px; height: 0px;"></span><br>

缺陷:认为每种成分要是有一点不错,许多所有成分就一定会更好<br>

例:“异或”,“确定开启的单位数是奇数还是偶数”,“确定一串激活的单位是否对称”,“求加法”<br>

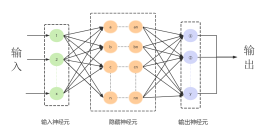

解决方法<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>:使网络更少像一个刺激-反应的生物,并在输入和输出层间给它一个内部表征<br>

例:异或<br><span id="transmark" style="display: none; width: 0px; height: 0px;"></span>

更好的解决方法:隐含层网络:输出单位对每个隐含单位反向传播一个信号,代表着隐含单位对其所连接的所有输出单位的误差总和(“你传递了太多的激活”或“你传递了太少的激活”及多多少或少多少)。这个信号可作为代理教学信号用来调整隐含层的输入。从输入层到每个隐含层的连接都能被上下推动,来减少隐含层在给定当前输入模式的条件下调整过量或不足的倾向。这个程序被称为“误差反向传播”,简称为“反向传播”,可被后向迭代至无数层。<span id="transmark" style="display: none; width: 0px; height: 0px;"></span>