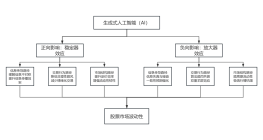

软件特性

软件一般性能

一般性能测试、 泛化能力测试、 鲁棒性测试以及安全性测试

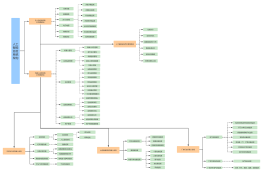

1. 一般性能测试:<br>AI 算法实现其预期用途的程度

1.1 常规数据表现测试法:<br>检测模型在一般数据集上的表现,避免特殊样本过拟合<br>

测试环境:一般样本

测试方法:基于输入-输出关系进行观察

测试指标:专家人工标注得到的参考标准作为基准,<br>对被测试的 AI 医疗器械输出结果进行评分

1.2 效率测试法:<br>检测模型占用显存内存计算量等参数, 排除低效率的模型<br>

测试环境:技术要求规定的环境

测试方法:基于输入-输出关系进行观察

测试指标:CPU 、GPU及内存占用量等模型参数

1.3 应用场景效率测试法:<br>检测模型在应用场景下, 分析样本的速度(“实时分析”情况)<br>

测试环境:场景算力的标准测试环境

测试方法:基于输入-输出关系进行观察

测试指标:每秒分析样本的份数(fps,运算速度)

2. 泛化性能测试:<br>AI算法对陌生样本的适应能力<br>

2.1 患者亚人群组合测试法:<br>利用具有多样性和变化性的数据, 对模型进行测试<br>

测试环境:组合不同患者亚人群的样本

测试方法:基于输入-输出关系进行观察

测试指标:专家人工标注得到的参考标准作为基准,<br>对被测试的 AI 医疗器械输出结果进行评分

2.2 压力样本测试法:<br>检测模型针对困难样本分类能力, 提升模型间区分度<br>

测试环境:困难样本

测试方法:基于输入-输出关系进行观察

测试指标:专家人工标注得到的参考标准作为基准,<br>对被测试的 AI 医疗器械输出结果进行评分

2.3 混合征样本测试法:<br>检测模型识别存在多个相似标签时的多标签分类能力<br>(多种病灶或多种相似疾病同时发病的情况)<br>

测试环境:多种标签(代表类别) 的样本

测试方法:基于输入-输出关系进行观察

测试指标:专家人工标注得到的参考标准作为基准,<br>对被测试的 AI 医疗器械输出结果进行评分

2.4 跨设备样本测试法:<br>检测模型针对不同设备采集的同种数据的鲁棒性<br>(临床器械品牌较多的情况)

测试环境:多种常用型号医疗器械记录的产品样本

测试方法:基于输入-输出关系进行观察

测试指标:不同设备中产生的样本识别效果

3. 鲁棒性能测试:<br>检验模型对异常问题的应对能力<br>

3.1 自然噪声样本测试法:<br>检测模型对抗自然噪声的能力, 提升模型表现间区分度<br>

测试环境:存在较大自然噪声的样本(如来自特定厂家产品的数据)

测试方法:基于输入-输出关系进行观察

测试指标:识别准确率

3.2 不合格样本测试法:<br>检测模型拒绝无法分类样本的能力, 避免错误分类<br>(“不合格样本检出” 特性AIMD)

测试环境:不合格样本(非该疾病类型的样本、 医学影像中的错片和废片等)

测试方法:基于输入-输出关系进行观察

测试指标:采用召回率评估被测试产品对错误样本的识别效果

3.3 可信区域测试法<br>模型适用范围的确认, 是模型泛化能力的补充<br>

测试环境:不同类别、 采集自不同设备、 适用于不同任务的样本

测试方法:基于输入-输出关系进行观察

测试指标:采用准确率(Acc) 、 AUC 以及使用五折交叉验证后二者指标的方差符合预定阈值

3.4 结果一致测试法<br>验证模型的临床应用分析是否建立在关键特征分析上的测试方法<br>

测试环境:对抽样的样本进行变换操作(如对图像进行裁剪、 翻转, 对文本进<br>行 one-hot 嵌入, 对心电图进行傅里叶变换等) 后和变换前组成样本对

测试方法:基于输入-输出关系进行观察

测试指标:一致率指标, Consistent不低于专家多次反复判断的一致率

3.5 对抗攻击测试方法<br>测试模型能否抵抗部分恶意输入攻击, 检测模型稳定性<br>(一般用于深度学习网络的攻击算法)

测试环境:Carlini and Wagner(C&W);通用扰动方法(UAP)

测试方法:基于输入-输出关系进行观察

测试指标:测试 AI 医疗器械预测的算法性能无明显下降

3.6 结果无偏测试法<br>测试模型在有偏训练集上能否抵抗偏差<br>

测试环境:对样本进行编辑等操作, 使用裁剪等方式抹去数据中除关键特征点(如肿瘤) 外的无关特征, 或使用翻转、 旋转等数据增强方式<br>生成新的相关样本

测试方法:基于输入-输出关系进行观察

测试指标:精确度指标,数据预测准确率与原预测准确率相差不大于设定阈值

3.7 不确定性测试法:<br>测试模型参数对于样本不确定性是否过于敏感<br>

测试环境:过对标准样本的各个输入施加一个极小扰动 , 通过中心差值近似估计模型的差分梯度

测试方法:通过样本输入的不确定性, 估计模型输出的不确定性

测试指标:模型的输出不确定性应小于一定阈值

4. 安全性能测试

4.1 隐私保护测试法:<br>验证产品是否有涉及隐私提取和泄露的行为<br>

测试环境:标准测试环境

测试方法:运行多种隐私风险监测工具对被测 AI 医疗器械的代码和接口<br>进行全方位分析

测试指标:是否调用了网络权限、 系统权限、 数据库数据等<br>是否有上传隐私数据的行为<br>

4.2 模型推断攻击测试法:<br>验证产品是否能通过特定测试样本推断泄露模型参数<br>

测试环境:标准测试环境

测试方法:通过上传特定测试样本, 根据模型输出结果估计模型中的重要参数

测试指标:分析结果得到的参数与真实模型参数差距小于由专家认定的阈值

4.3 模型部署攻击测试法:<br>验证产品在模型加载数据、 加载预训练权重文件等过程进行攻击下能否正常工作<br>

测试环境:标准测试环境

测试方法:对模型加载数据、 加载预训练权重文件等过程进行攻击

测试指标:测试检查模型能否在部署攻击下进行正常数据和权重加载