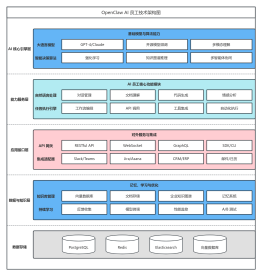

AI大模型应用体系-知识体系-分层架构-大模型架构图

2025-12-30 08:22:14 2 举报

AI大模型应用体系的分层架构是一种模块化的方法,旨在通过一系列组织良好的层次来管理和部署人工智能技术。核心内容包括数据处理层、模型训练层、推理服务层和应用集成层。数据处理层负责收集、清洗和预处理数据;模型训练层则专注于训练高性能的AI模型;推理服务层提供模型部署和实际决策支持;应用集成层使这些服务能够无缝融入最终产品或解决方案。整个体系的特点在于它的可扩展性、灵活性和强大的数据驱动能力,适用于广泛的行业应用。该体系不仅强调技术的高效实施,还注重安全性、合规性和易用性,使得无论是技术专家还是最终用户都能从中受益。分层架构通过明确职责分工和优化资源利用,为构建稳定、可靠且可持续发展的AI生态系统打下坚实基础。

模板推荐

作者其他创作

大纲/内容

0 条评论

下一页