7、数据分析&运营

分析框架

分析背景-目的-明细指标解释-数据获取来源-数据概览-数据拆分-结论汇总-后续改进-附件

数据分析方法论

数据分析工具

Excel

PowerBI/QuickBI

Python/R

数据运营方法论

增长黑客

流量运营

用户运营

产品运营

内容运营

8、数据可视化

把一些统计性、结论性数据通过可视化框架表现

熟悉掌握各类图表的含义与用法

WebGL、Ant-VD3、three.js、MapBox

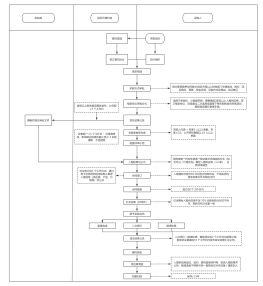

数据调研-数据开发-数据服务-可视化呈现

调研阶段:背景与目的、业务目标、业务范围、业务需求和功能需求

了解当前数据状况、质量、满足主题的原始数据

数据开发:离线、实时、算法

1、数据采集

线上行为采集

客户端SDK埋点

无埋点(全埋点)

代码埋点

可视化埋点

服务端SDK埋点

服务端SDK

HTTP中access_log

线下行为采集

硬件采集:Wi-Fi、摄像头、传感器、图像视频

互联网数据采集

网络爬虫-在遵守相关协议的情况下,不断爬取互联网上的信息,对内容进行处理后提供相应的检索服务

Google、百度

2、数据清洗

数据组织形式

结构化数据:规则、完整、能够通过二维表逻辑来体现的数据,严格遵循数据格式与长度规范,常见的有数据库、Excel等

半结构化数据:规则、完整、遵循数据格式与长度规范但无法通过二维表表现,如JSON、XML等

非结构化数据:结构不规则、不完整、不方便使用二维逻辑表现,需要经过复杂的扩及处理才能提取,如办公文档、图片、图像、视频

清洗原则:完整性、唯一性、合法性、权威性、一致性

常见操作:删除多列、更改数据类型、将分类变量转换为数字变量、检查缺失数据、删除列中的字符串、删除列中的空格、用字符串连接两列(带条件)、转换时间戳(从字符串到日期格式)

3、数据汇聚/交换

数据源管理

关系型数据库:Oracle、MySQL、SQLserver、Greenplum等

NoSQL储存:Hbase、Redis、Elasticsearch、Casssndra、MongoDB、Neo4J

网络及MQ:Kafka、HTTP

文件系统:HDFS、FTP、OSS、CSV、TXT、Excel

大数据相关:Hive、Impala、kuduMaxCompute、ADB、LiberA、ELK

离线数据交换

场景:时效低、吞吐量大、大规模迁移

实现方式

原理:将不同数据源的交换抽象为从源头数据源读取数据的读取插件,以及向目标写如数据的写入插件

读取插件:数据采集模块,负责采集数据源的数据,将数据发送给数据交换中心模块

写入插件:数据写入模块,持续从数据交换和心模块取数,写入目的端

数据交换核心模块:连接读取和写入插件,作为两者的数据传输通道,并在处理缓冲、流控、并发、数据转换等核心技术问题,可进行场景化的定制,如:字段截取、替换、编码转换等操作

理论上支持任意数据类型,非结构化数据可通过快粘插件等方式交换,其场景是以文件或者数据块的方式进行交换

技术亮点

前置稽核:源数据同步开始前进行数据质量规则校验,根据配置规则的阻塞,告警策略控制数据同步是否进行

数据转换:将各类非标转数据转换成标准数据格式,转换后的数据推送到大数据平台指定的位置或库表

跨集群数据同步:采用插件化的设计思路,数据同步模块支持不同集群间的数据同步,例如:A-B,只需要开发A的Reader和B的Writer,便可新建数据同步作业

全量同步

表全量同步-每次读取表中全量数据并且写入

库全量同步-将库中所有表进行数据同步,要求源端和目的端的表名称、结构相同,允许目标表不存在,不存在时自动创建新表

增量同步

新增-在目的端创建新分区或者直接追加写数

覆盖&更新-在配置时,选择唯一主键,根据唯一键对比同步中的数据和目的端数据,结合增量策略来判断是覆盖还是更新

实时数据交换

主要负责把数据库、日志、爬虫等数据实时介入Kafaka、Hive、Ocracle等储存中

核心服务

数据订阅ClientSever-数据的订阅和读取,任务实例启停控制

数据消费ConsumerSever-数据消费主要包括任务状态控制、数据解析、数据过滤、数据转换、数据写入等功能,通过TCP通信方式和数据订阅方式定型数据读取和传输,经过任务配置的过滤、转换等功能写入到目的端数据源中

5、数据计算

批计算

批量数据的高延时处理场景,吞吐量大、延时高,适合人机交互

离线数仓加工、大规模数据清洗和挖掘

MR、Hive、Spark

流计算

实时数据、秒级RT、监控告警、网络分析等

Flink、Spark、Streaming Storm

在线查询

数据结果的在线查询、条件过滤、筛选、数据检索、过滤

对响应延时要求高的-缓存型储存数据计算Redis、Tair

对响应延时啊哟求正常的,Hbase、MySQL

画像服务-根据富相标识提供具体的查询服务,通过Redis可以提供低延迟、高并发的查询能力

即席分析

常见的实现方式

ROLAP-关系型数据库为核心,关系型结构进行多维数据的表示和存储,结合星型模式和雪花模式实现

MOLAP-基于多维数据组织实现,多维数据组织为核心,形成立方块多结构,通过对立方块进行各类处理

常见的场景

群体对比分析场景、A/B测试

交互数据分析

6、数据挖掘统计

从大量的数据中,通过统计学、人工智能、机器学习等方法,挖掘出未知的、且有价值的信息和知识的过程

分类-监督学习领域核心问题,用于推测输入数据的类别

银行预测客户逾期

新闻领域预测新闻所属类别

医学领域预测病人是否患病

GBDT、而分类、线性支持向量机、K临近、决策树分类、多层感知机分类、朴素贝叶斯、LightGBM、随时森林、逻辑回归

回归-监督学习领域重要问题,预测输入输出变量之间的关系

股价、销量、房价、营业额预测

GBDT回归、随机森林吗、线性回归、LightGBM回归

聚类-无监督学习领域研究较多的问题

将数据分簇,簇内样本较为相似,簇与簇之间样本差距较大

电商用于发现兴趣相似的用户,经过预处理和特征工程

kmeans、高斯混合

深度学习

主流框架:Tensorflow、MXNet、Caffe、XGBoost、LightGBM

文本分析

文本特征处理,模型构建实现文本分类、关键词抽取、摘要生成

PLDA、TF-IDF、Word2Vec、Doc2Vec、词频统计、去停用词、分词处理、关键词抽取

网络分析

用于解决包含网状关系的业务场景

金融风控、社群发现、最短路径

最大连通子图、标签传播分类、标签传播聚类、Modularity、树深度

工具类

数据处理、特征工程、机器学习、深度学习、文本处理、图像处理、视频处理、人脸识别、OCR识别、车牌识别、知识图谱构建与推理