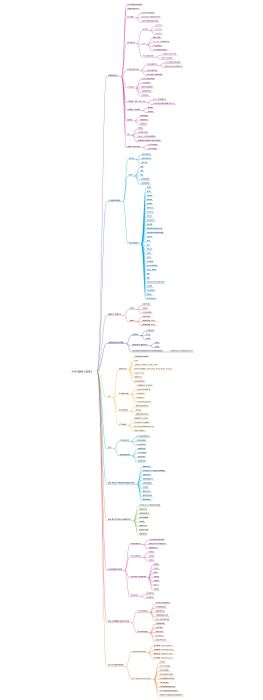

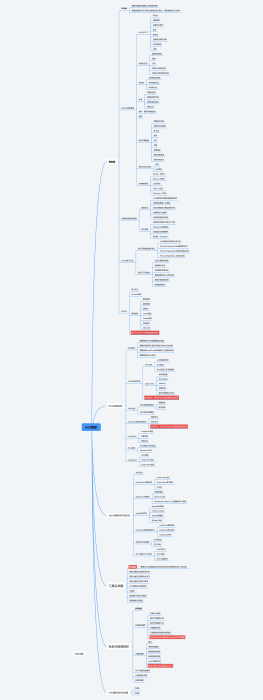

AI机器学习总结笔记

2024-06-20 16:26:54 0 举报AI智能生成

AI机器学习总结笔记是一份关于人工智能和机器学习领域核心概念、技术和应用的全面回顾。它涵盖了从机器学习的基本原理到深度学习、神经网络和最新研究成果的各个方面。这份笔记旨在帮助读者理解AI和机器学习的基本知识,为更深入的学习和实践打下基础。这份资料采用脑图格式,便于阅读和打印,并配有丰富的图表和示例,使复杂的概念更易于理解。

AI

机器学习算法

机器学习

人工智能

人工智能算法

模板推荐

作者其他创作

大纲/内容

Numpy

数据结构ndarray

Scipy<br>

向量

矩阵

特征值和特征向量

解线性方程组

最小二乘

模块

cluster

聚类算法

constants

物理和数学常量

fftpack

快速傅里叶变换

integrate

积分和常用微分方程

intepolate

插值和样条平滑

linalg

线性代数

ndimage

图像处理

optimize

最优化及求根<br>

signal

信号处理

sparse

稀疏矩阵

spatial

空间数据结构及算法

special

特殊函数<br>

stats

统计分析

python

pandas<br>

数据加载

数据修改运算

多层索引

数据变形

关联

分组与聚合

数据重塑

matplotlib<br>

折线图

散点图

直方图

条形图

饼图

箱线图

数学基础<br>

数学体系

线性代数

一元线性回归

多元线性回归

广义回归模型

矩阵

加法

矩阵相加

结合律

交换律

乘法

矩阵乘法

结合律

分配律

行列式

det(MN)=det(M)det(N)两个矩阵 M, N,积的行列式=行列式的积 行列式行数必须等于列数。也就是说必须<br>是方阵才有行列式

矩阵的转置

<br>

矩阵的初等变换

1. 换法变换:对换矩阵的两行。对换i,j两行,记作ri <->rj。<br>2. 倍法变换:用非零数乘以矩阵某一行的每个元素。第i行乘以K,记作ri*k.<br>3. 消法变换:用数乘矩阵某一行的每个元素后加到另一行的对应元素上,第j行的k倍加到第i行上,记作ri +<br>krj。

初等行变换

初等列变换

高斯消元

(1)任意交换矩阵的两行或两列,矩阵不变;<br>(2)矩阵任意行或列加上或减去任意k倍的任意行或列(行也可以加减k倍的行),矩阵不变;

逆矩阵

逆矩阵可以类比成数字的倒数,比如数字5的倒数是1/5,矩阵A的“倒数”是A的逆矩阵。5*(1/5)=1, A*(A的<br>逆矩阵) = I,I是单位矩阵(个别教材叫做E)

引入逆矩阵的原因之一是用来实现矩阵的除法。比如有矩阵X,<br>A,B,其中X*A = B,我们要求X矩阵的值。本能来说,我们只需要将B/A就可以得到X矩阵了。但是对于矩阵来<br>说,不存在直接相除的概念。我们需要借助逆矩阵,间接实现矩阵的除法。

矩阵的秩

矩阵A中非零子式的最高阶数为矩阵A的秩,记作r(A).r(A)=2.

点乘、内积

子主题

特征值

任意给定一个矩阵A,并不是对所有的向量B都能被A拉长(缩短)。凡是能被A拉长(缩短)的向量称为A的特征向<br>量(Eigenvector);拉长(缩短)量就为这个特征向量对应的特征值(Eigenvalue)<br>

子主题<br>

微积分

导数

速度

切线的斜率

导数

导函数

子主题

求导公式

四则运算

子主题<br>

子主题<br>

子主题<br>

子主题

子主题<br>

子主题

求导法则<br>

初等导数公式

高阶导数

加法

莱布尼茨公式

有限增量公式

雪花曲线

周长无界,面积有界

运算法则

洛必达法则

极值

极大值

极小值

单变量微积分

导数

公式

中值定理

洛必达法则

泰勒公式及应用

函数的凹凸性

函数的极值

不定积分

定积分

偏导数

概率论

最优化<br>

无约束最优化梯度下降

约束最优化

数据挖掘<br>

六大任务

分类问题(Classification)

垃圾邮件

文本分类

信用评分

欺诈检测

图像识别

用户流失预测<br>

营销响应预测

广告点击率预估

商品推荐

聚类问题(Clustering)

用户分群

相似文档聚类

回归问题(Regression)

房价预测

收入预测<br>

关联问题(Association)

商品买了还买

电影看了还看

商品推荐

序列问题(Sequence)

购物模式预测

网站点击模式预测<br>

中文分词

DNA序列分析<br>

异常检测问题(Outlier Detection)<br>

信用卡欺诈检测

网络安全检测

不合格产品检测

CRISP-DM 标准流程

商业理解(Business Understander)<br>

目标是什么?

商业目标

数据挖掘目标

资源评估

制定项目计划

数据理解(Data Understander)

有哪些可用数据?

收集数据

探索数据

数据质量

数据准备(Data Preparation)<br>

特征构造

选择数据

数据集成和汇总

特征处理

特征选择

构建模型(Modeling)

机器学习训练模型

选择算法

训练模型

模型指标评价

模型评估(Evaluation)

模型是否满足要求?

模型可用性评估

下一步计划

模型发布(Deployment)

模型发布上线

模型发布计划

模型上线

模型监控和维护<br>

数据理解和探索<br>

认识数据

描述性统计分析<br>

表示位置

平均值

分位数

四分位数

表示分散程度

极差

最大值减去最小值

方差

越大表示变量值波动的越厉害<br>

标准差

越大表示变量值波动的越厉害<br>

变异系数

波动性归一, 不同变量的波动性可比<br>

分类变量的分析方法<br>

频数分析

图形

饼图

条形图

帕累托图

连续变量的分析方法

离散化处理

频数分析

图形

饼图

条形图

帕累托图

直方图

相关性分析

散点图

交叉表

均值对比(方差分析)<br>

概率

基本空间与随机事件

事件的关系与运算

包含

相等

互不相容<br>

德摩根公式

总结

事件的概率

随机变量的分布

离散情形

伯努利分布

二项式分布

几何分布<br>

泊松分布

连续型随机变量

正态分布

均匀分布

指数分布

伽马分布

贝塔函数

期望与方差<br>

期望

联合分布

条件分布与条件期望<br>

正态分布

总体与样本

样本均值与方差

次序统计量与分位数<br>

矩法估计

极大似然估计

贝叶斯估计

区间估计

假设检验

多元线性回归

判别分析

系统聚类法

动态聚类法

主成分分析

样本主成分及应用<br>

特征转换

RFM数据提取

无量纲化

标准化

<br>

区间缩放法

<br>

连续变量数据变换

log变换

box-cos变换

squart

等宽离散化

等深离散化

自定义区间离散化

类别型变量数据变换

OneHot(独热编码)

频数<br>

去量纲化

秩序

归一化

目标变量

某类的比例编码

缺失值处理

日期处理<br>

特征组合

数据降维主成分分析(PCA)

数据降维之线性判别分析法(LDA)<br>

特征选择

Filter(过滤)方法

对每一个特征单独评估重要性,排序后筛选

重要性指标

卡方验证

相关系数

信息增益

信息值(IV)

优点

计算简单

防止过拟合好

缺点

不考虑特征之间的关联性,容易选出来冗余特征

Wrapper(封装)方法<br>

对每一个特征子集通过训练一个分类模型,根据模型的性能来评价特征的重要性

常用

逐步回归 Stepwise

向前选择 Forward

向后选择 Backward<br>

优点

特征选择效果好

缺点

算法复杂度高,耗时

针对特定算法来做的,灵活性不强

Embedded(嵌入)方法<br>

特征选择算法本身作为组成部分嵌入到学习算法里

以决策树为例,数的增长过程就是一个特征选择的过程<br>

优点

特征选择效果好

缺点

针对特定算法来做的,灵活性不强

模型优化

数据

算法

调参

分类模型评估及验证

模型误差

偏差

方差

过拟合

欠拟合

评估方法

数据集划分

K折交叉验证

模型评估指标

误分类矩阵、准确率、召回率、F1分数<br>

误分类矩阵

准确率

召回率

正确率

F1 分数

收益曲线

ROC 与 AUC

KS 曲线与KS值

判断标准

模型训练、验证、评估流程

数据集划分3个方案<br>

Sckit-learn<br>

数据集<br>sklearn.datasets<br>

特征工程

特征工程-预处理<br>sklearn.preprcessing<br>

规范化<br>

MinMaxScaler 最大最小值规范化

Normailzer 将样本归一化为单位范数

StandardScaler 通过删除平均值和缩放到单位方差来标准化特征<br>

编码

LabelEncoder 把字符串类型的数据转化为整型<br>

OneHostEncoder 特征用一个二进制数字来表示<br>

Binarizer 为 数值型特征的二值化

MultiLabelBinarizer 多标签二值化

数据变换

Polynomisreatures 生成多项式和交互特征<br>

缺失值

imputer 用于完成缺失值的插补变压器

特征工程-特征提取<br>sklearn.feature_extraction

图像类

image.img_to_graph 像素到像素梯度连接的图形<br>

image.grid_to_graph 像素到像素连接的图形<br>

文本类

text.CountVectorizer 将文本转化为每个可出现个数的向量<br>

text.TfidfVectorizer 将文本转为tfidf值的向量<br>

text.HashingBectorizer 文本的特征哈希<br>

特征工程-特征选择<br>sklearn.feature_selection

Filter过滤器

VarlanceThreshold 删除特征值的方差达不到最低标准的特征<br>

子主题

SelectKBest 返回K 个最佳特征<br>

SelectPercentile 返回表现最佳的r%个特征<br>

Wrapper 包装器

PFE 递归删除特征法

Embedded 嵌入法

SelectFromModel 基于模型的特征选择<br>

特征工程-特征<br>sklearndecomposition

主成分分析

PCA 主成分分析(PAC)

因子分析

FactorAnalysis 因子分析(FA)

模型训练

线性、广义线性模型<br>sklearn.linear_model

LinearRegression 普通最小二乘线性回归

LogisticRegression Logistic 回归(又名logit,MaxEnt)分类器<br>

朴素贝叶斯模型<br>sklearn.naive_bayes

GaussianNB 高斯朴素贝叶斯

MultlnomialNB 朴素贝叶斯分类器多项式模型

BernoulliNB 朴素贝叶斯分类器多变量伯努利模型

最近邻模型<br>sklearn.neighbors

KNeighborsClassifier 执行k-最近邻居的分类器投票

神经网络模型<br>sklearn.neural_network

neural_network.MLPClassifier([]) 多层感知器分类器

neural_networkMLPRegressor([]) 多层感知器回归

SVM模型<br>sklearn.svm

SvC C支持向量分类

LinearSVC 线性支持向量分类

决策树<br>sklearn.tree

DecisionTreeClassifier 决策树分类器

DecisionTreeRegressor 决策树回归

聚类 <br>sklearn.cluster

KMeans k均值聚类

SpectralClustering 将聚类应用于对规范化控普拉斯算子的投影

模型选择<br>sklearn.model_selection

交叉验证(原cross_validation)

KFoldK-Fold 交叉验证迭代器。接收元素个数、fold 数、是否清洗<br>

LeaveOneOut LeaveOneOut 交叉验证迭代器

LeavePOut LeavePOut 交叉验证迭代器

LeaveOneLabelOut

LeavePLabelOut

数据集分割函数(原cross_vaildation)

train_test_split 分离训练集和测试集

模型验证(原cross_validation)

cross_val_score 通过交叉验证评估分数

cross_val_predict 为每个输入数据点生成交叉验证的估计<br>

permutation_test_score 评估其有置换的验证分数的意义<br>

learning_ourve 学习曲线

validation_curve 验证曲线

超参数优化(原grid_search)

GridSearchCV 搜索指定参数网格中的最佳参数

ParmeterGrid 参数网格

ParameterSampler 用给定的分布生成参数的生成器

RandomizedSearchCV 超参数的随机搜索

模型组合<br>sklearn.ensemble

BaggingClassifier Bagging 分类器组合

BaggingRegressor Bagging 回归器组合

AdaBoostCalssifier AdaBoost 分类器组合

AdsBoostRegressor Adaboost 回归器组合

OradiendBoostingCalssifier 分类器组合

OradiendBoostingRegressor 回归器组合

RandomTreeClassifier 随机森林分类器组合

RandomTreeRegressor 随机森林回归器组合

VationgClassifiter 多模型投票融合器

模型评估<br>sklear.metrics

回归结果度量

explained_varcance_score 可解方程的回归评分函数

mean_ebsolute_error 平均绝对误差

mean_squared_error 平均平方误差

分类结果度量

accuracy_score 分类准确度

condusion_matrix 分类混淆矩阵

classification_report 分类报告

precision_recall_fscaor_support 计算精确度、召回率、1. 支持率

jaccard_simliarty_score 计算jceard 相似度

hamming_loss 计算汉明损失

zero_one_loss 0-1损失

hinge_loss 计算hinge 损失

log_loss 计算log 损失

聚类的度量

adjusted_mutual_info_score 调整的互信息评分

silhouette_score 所有样本的轮廓系数的平均值

silhouetle_sample 所有样本的轮廓系数

多标签的度量

coverage_error 函数误差

label_ranking_average_precision_score 计算基于排名的平均误差()

模型算法<br>

一元线性回归

多元线性回归

非线性回归

逻辑回归

K近邻

决策树

支持向量机

朴素贝叶斯<br>

回归树

K均值

关联规则Apriori算法<br>

KNN

TF-IDF算法

卷积神经网络CNN

图像领域

图像识别

人脸检测

人脸分析

人脸对比

人脸搜索

图像分类

目标检测和定位

图像搜索

应用领域

无人驾驶

感知

周围物体辨识(车辆、行人、自行车、交通灯、标志等)<br>

定位

决策

控制

拍照识物

物体检测和定位

以图搜图

拍图购物

风格迁移

智能审核

色情过滤<br>

暴恐过滤

广告过滤<br>

循环神经网络RNN

序列预测

文本

视频

语音

时间序列

应用领域

天气、股票

情感分析

文本正负面

模拟写作

模仿某个作家进行创作

看图说话

机器翻译<br>

算法融合

Voting(投票)<br>

针对分类问题

硬投票

针对标签

软投票

针对概率

Averaging(平均)<br>

针对回归问题

简单平均

加权平均

Bagging

子主题

采用算法

随机森林

减少方差

Boosting<br>

子主题

采用算法

Adaboost算法<br>

GBDT

XGBoost

减少偏差

文本分析<br>

词袋 Bag of words<br>

词嵌入 Word Embedding<br>词向量 Word2Vec<br>

Collect

Get Started

Collect

Get Started

Collect

Get Started

Collect

Get Started

评论

0 条评论

下一页